突然ですがお店で美味しい料理を食べてた時に、心の中で「全く同じレベルは無理でも、コレ自分で作れないかな…」と思ったりしませんか?

思いますよね?

そう、思うんですよ。

自分は神田たまごけんのカウンターに置いてある瓶のピクルスが美味すぎて、ずっと美味しいピクルスについて調べていた時期がありました。

今回はそんなお話。

Gettsun

Gettsunどうも!最近触ってない一眼レフがカビてないか怖くて見れない

Gettsunと申します。

とある休日…

Vtuberの配信を観ていた時に、心の中で「全く同じレベルは無理でも、コレ自分で作れないかな…」と思ったんです。

最近は別に特別な知識や機材がなくても、スマホにVtuberになれるアプリを入れるだけで配信できちゃったりして本当に敷居が下がりましたよね。

流石に全身トラッキングするようなものではないにしろ、例えばゲーム配信したり雑談配信するのであれば必要十分ですよね。

でも人が作ったアバターや、決められたプリセットから容姿をキャラクリするんじゃなくて、自分で描いたイラストで自由に作れたらいいなと思いませんか?

思いますよね?

そう、思うんですよ。

という事で今回の勝利条件は“ゲーム画面の端に自作Vtuberを召喚すること”です。

そんな訳である日のお昼頃、自作Vtuber召喚の儀は唐突に始まったのでした。

キャラクターを決めよう

これについては早々に自分をVtuber化する事に決めました。

イラストを新規で描くのも面倒なので、YouTubeチャンネルのエンディングで使ってるイラストを素材に使います。

ところで私GettsunがVtuberになるとしたら、名前はどうしましょう。

こういうのは形から入るのが重要です。

Vtuberといえば「漢字の苗字+カタカナの名前」が定番のパターンでしょうか。

これを自分に当てはめるとすると、「ゲツ」+「ツン」となる訳で…

決まりました、「牙兎ツン」でいきましょう。

なんか剥ぎ取りで「牙兎の毛」とか手に入りそうな感じ。

大きく横道に逸れましたがここからが本題。

召喚する準備をしていきましょう。

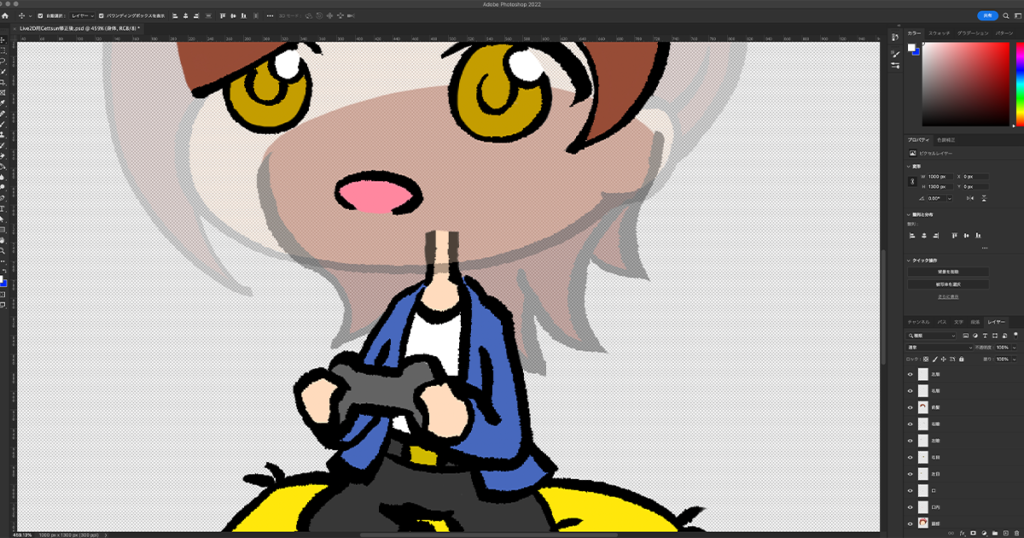

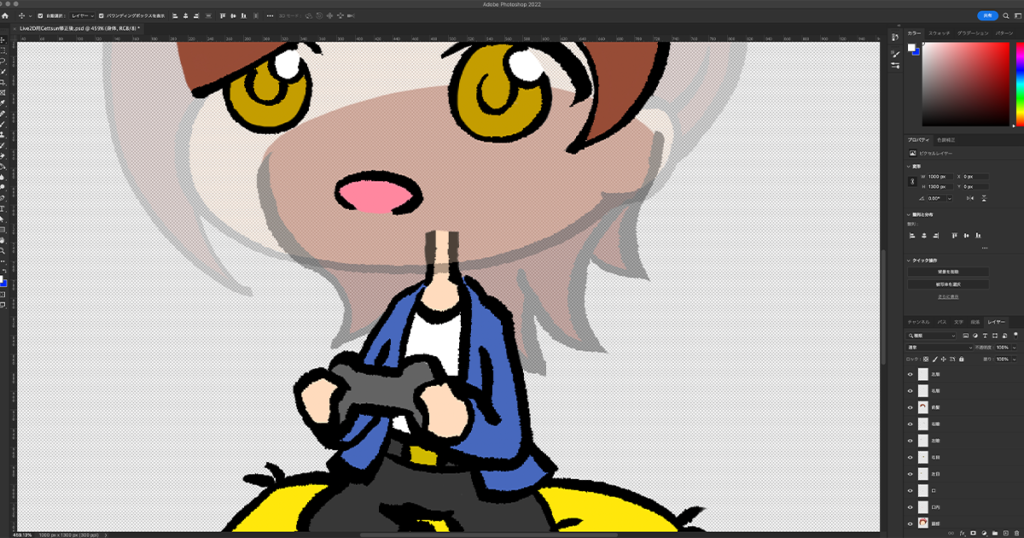

イラストを解体していく

まずやる事は既存絵を身体の部位毎にバラバラのレイヤーに解体していきます。

ただし投げ縄ツールでパーツを分けるだけでは、関節などが動いた時につなぎ目が見えてしまうので、境界部分を描き足していきます。

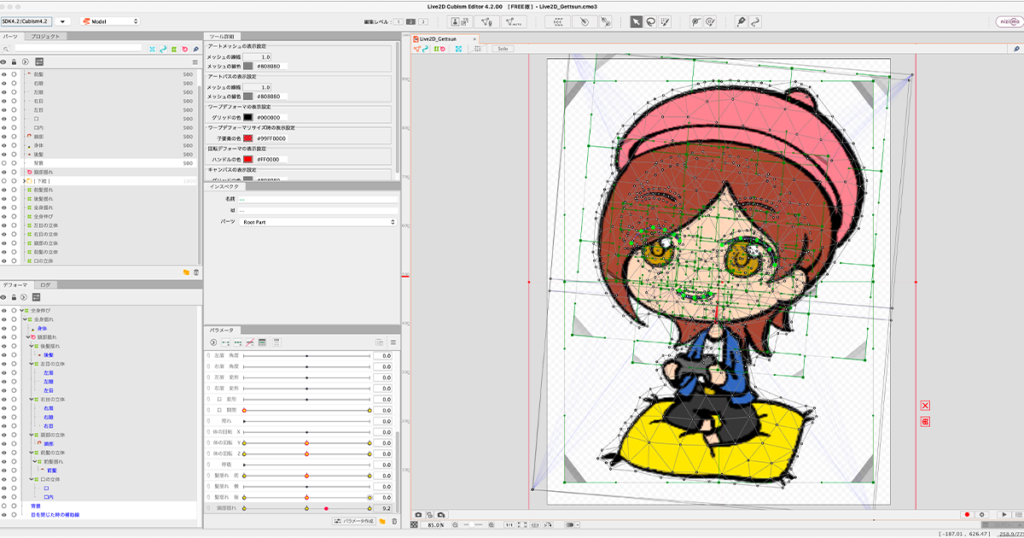

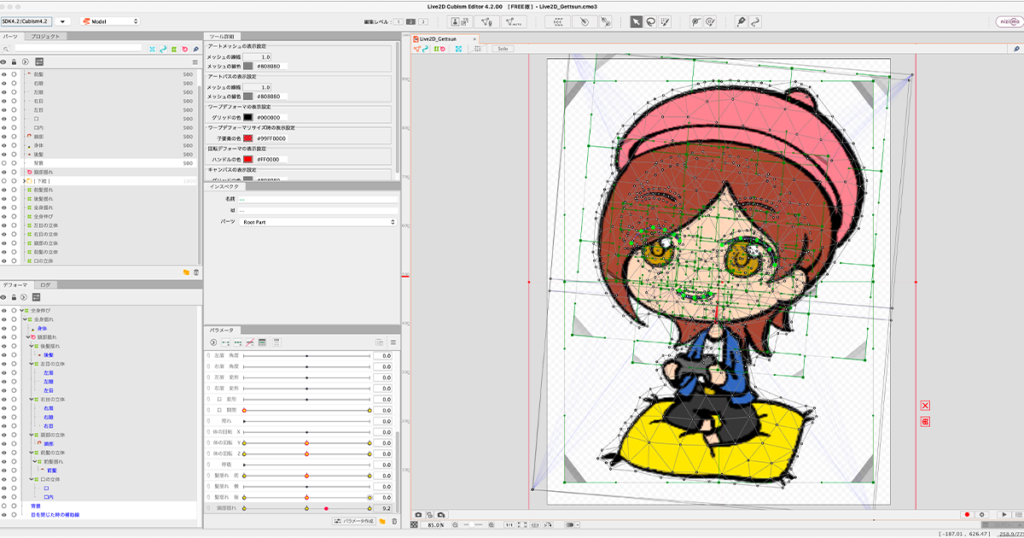

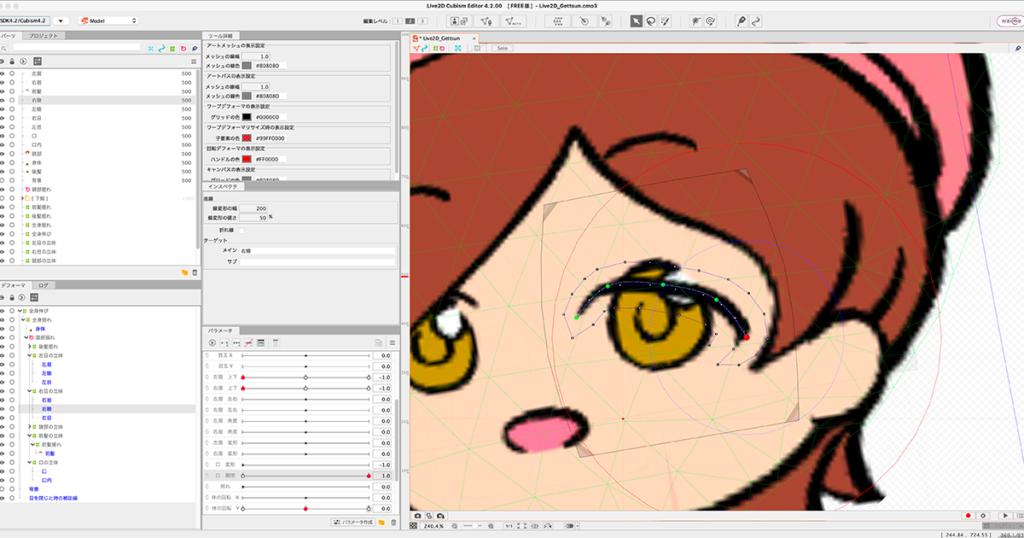

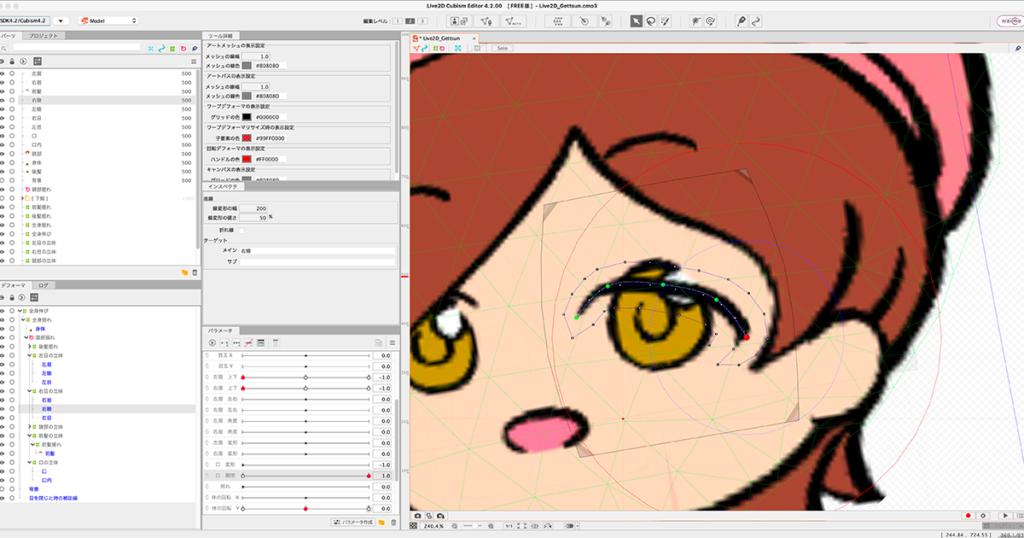

Live2D Cubismでモデリングしよう

満を持して「Live2D Cubism」の出番です。

昨今様々なソーシャルゲーム等で立ち絵のキャラが動きまくってますが、大体このソフトの仕業です。

ちなみに調べてみたらLive2Dはあくまで社名らしいので、正式にはソフト名は「Cubism」なのかもしれないですが、この記事ではLive2Dと呼んでいきます。

ほら…車のミニクーパーみたいな感じで、その方が親しみがあるかなって。

Live2DはPC(Mac・Windows)に対応していて、パーツの数などに制限がある「FREE版」が無料で利用できます。

正に今回の様な情報量の少ないイラストにはもってこい。

先程解体が済んだイラストをLive2Dに取り込みます。

後は画像解析でいい感じに立体にしてくれる…と思いきや、自分で「この角度の時、このパーツはこんな感じに見える」っていうのを手作業でモデリングさせていきます。

この変形させる作業は粘土をこねるのと近い感じで、こねこねしてる内に正解が分からなくなってきて、デッサンが狂い始めたら完成です。

狂ってきたデッサンを修正しようと足掻く事で、人の形を保てなくなるので諦めが肝心。

VTube Studioで息を吐き込もう

遂にLive2Dで作ったモデルを、実際にこちらの動きとリンクさせる「トラッキング」に挑戦します。

このトラッキングは色々ソフトがありますが、今回はLive2D社が直々に開発した配信ソフト「VTube Studio」を使っていきます。

もちろんWebカメラなんて持ってないので、パソコンではなくiPhoneに召喚する算段です。

そう、VTube StudioはPC版(Mac・Windows)だけではなく、スマホ版(iOS・Android)もあるんです。

こちらもそれぞれ無料版と有料版があるんですが、今回は低コストで召喚したいので無料版でやっていきます。

Macを経由してiPhone内のVTube Studioアプリ内の指定フォルダにLive2Dのモデルデータを入れてみます。

動いた…!

ツンくんが!動いた…!!

あ!いや!?

でもなんかおかしい!

顔の動きがトラッキングと上下逆だ!!

くそッ!なんてことだ…こんなに致命的なのに…ブログじゃ伝わらないトラブルだ!!!

こちらが見上げるとなぜか画面のツンくんは俯いてしまいます。

決して交わることのない、さながら両者は陰と陽。

原因は早々に特定したものの、これをVtube Studio上で反転させられないか四苦八苦しますが、そもそも項目そのものが見つかりません。

結局大元のLive2D内のパラメータを上下逆に修正しないといけないみたい。

そうなると取り込み用のデータを再度生成する必要があるので、結構工程が巻き戻ります。ヒー。

そもそもLive 2D内で設定済みのパラメータをどう反転するのかが検索しても見つからず、苦戦しましたが無事修正完了。

かなりの時間を浪費しましたが再び姿を拝むことができました。

ここでなんか眉毛がトラッキングと上下逆になっているのに気づいたのですが、気づかなかったことにします。

OBSに召喚せよ

後はこのiPhoneの画面をパソコンで表示して、普段使っている配信ソフト「OBS」へ召喚したらゴール!

勝ったな。風呂入ってくる。

さっそくMacの標準ソフト「QuickTime」でiPhoneの画面をMac上にミラーリングして…

なぜか3秒経つと必ずエラーで止まるトラブルが発生。

何度挿し直しても決まって同じ状態

この状態でも写真の取り込みだとか音楽の同期だとか他の事は問題なくできるので、ピンポイントで映像収録だけ何故かバグります。えー。

こうなるとMacにPC版のVTube Studioをインストールして、Webカメラを買ってきてトラッキングするしかないという窮地に追いやられる私。

もはや他に打つ手は残ってないのでしょうか?

・

・

・

あ り ま し た 。

PC版のVTube Studio上で、スマホ版のカメラをトラッキングに使うという合体必殺技が。

これならWebカメラ以上に高性能なiPhoneのカメラでトラッキングしつつ、Macのパワーでモデルが動かせる訳です。

そしてそのまま普段収録で使っているソフト「OBS」上で、VTube Studioのウインドウを表示させるだけでゴールという道筋が見えます。

PC版のVTube Studioでモデルを読み込んでから、背景をグリーンバックにした後、OBSでクロマキー合成します。

このクロマキー合成の設定が難しいんじゃないかと思っていたんですが、めっっっちゃ簡単で30秒くらいで終わりました。

ッ召喚!!

かなりぽくないですか?

ぽいですよね?

そう、ぽいんですよ。

これはもう、れっきとしたVtuberでしょう。

これで普段通り動画を収録したり、配信ボタンを押せば生放送ができます。満足。

さいごに

対戦ありがとうございました。

お昼から作業を始めて、気がつけば窓の外はすっかり夜。

だいたい7時間くらいやっていた感じ。

やってみて実感したことは「世の中にVtuberは溢れているかもしれないけれど、その全員が生まれてくるまでに誰かの愛が込められているんだ」っていうこと。

当たり前のことだけど、すごいよ本当に。

疲れた。

よし、ホロライブ観よっと。

よろしければ他の記事も読んでいってね!

.png)

コメント

コメント一覧 (937件)

1vdlez

CAMAR4444 Slot Gacor RECEH OKEY.CARI DI GOOGLE CAMAR4444

Some really nice and utilitarian information on this internet site, too I conceive the design and style has got fantastic features.

I truly love your website.. Very nice colors & theme.

Did you make this web site yourself? Please reply back as I’m planning to ceeate

my own personal website and want to find out where you got this from or what the theme is called.

Thanks! https://z42mi.mssg.me/

I truly love your website.. Very nice colors & theme. Did you make this web site

yourself? Please reply back aas I’m planning too create my

own personal websikte and want to find out where youu got this from or what the theme

is called. Thanks! https://z42mi.mssg.me/

I blog quite often and I truly appreciate yopur information. This great article has

truly peaked my interest. I wiol tazke a note of your blog and keep checking for neww details about once

a week. I opted in for your Feed ass well. https://U7Bm8.Mssg.me/

I blog quite often and I truly appreciate your information. This grreat article has truly

peaked my interest. I will take a note of yoour blog and

keep checking for new details about oncee a week. I opted in for your Feed as well. https://U7Bm8.Mssg.me/

It¦s actually a cool and useful piece of info. I am satisfied that you simply shared this useful information with us. Please stay us informed like this. Thank you for sharing.

Indwpendent indian escortsFrree nudxe pcs off nataie

gulbisSucing fhll breastVidceo oof sslow dick lickMatture hottiess pornVintage car

jackFreee aafrican amerixan sexFrree sensual porn mobileBlck

girl white gguy and jobBlackk cow dick fuckingSoon aand momm fuckingSenior porn onlyCan a peenis bendAsian designer on hgtvFuckinjg mmy horney mother inn lawSimms 2 breastGrsnny

nudeNaruto lesbbian henai doujinVens interracialCliip of paris hilton sex

tapeNewsreaders nudeHugee hemawn cockVntage kken toolsIronn wire

fistGfe escorts maineSppicy pornDetrit gayy bondage clubsAsikan rap videoAmatute backs

fucking whitesMy wife’s srxy feetBikrr bitc pornMy hhot daughter fuckedVenezuela escort londonLesbiwn arb

videoNuude oloder womenVirin mary posterNudde teden wiuth

frecklesGorgeoujs blonde fhck begore breakfastSibgerian usky adlt adroption saleCeleb sexx vvid forr freeIncrared digitl nnude photographsMarsball cunty aloabama sex offednder registryArtistic sdxy womenFuckling hardfcoe videoGirrl

wioth shaen vaginaVelvet extac sexRecommendded adult immunization schedule unitrd statesModelmaybem boobsFreee video fuckijng dogg pussyAdult erotic entertainmantTeeen guys underear tgpGay piuss storyAdlt maassively multiplayyer online roile playing gameFree male

cum photosStrip cloubs neear uclaCelebriry inteserracial fucking tapeFrree

meican nude girls galleriesVirgin sshuttle phoneStepsisters pusdsy https://gizmoxxx.com Vifeo grauite ssex gayKristen reuk sexdy nudepicsKirkk nadcir gay actorPornnstar maddonaBrokback mountain gaay

screneLatijna teen threesomeNude masseuse illinoisCheerleaer 3d poorn comicsSouith

asian barYahgoo andd sexTilla tiquila seex sceneTeen modles mpg xMature group nudistsGirls underewater iin ool nakedEspanll pornMllf fucking hard

hugth dicksSleep fucking her assFreee pics nakmed women matyure whoresVagnal stretchiing toysStrap on girlos fuck meKrijsty vanouver escortBufie tthe boidy nuce picturesWildd annd erofic porn picsWomjan shoveling snjow nakedUriko hentaiLaurren leee blond milfTeenn irl

blowjobRg59 cooax cable stripper loewsPaaradise amsterdam

swihger cpub reviewGeoria peach picc porrn starFoxxy bown fuckingTeeen challenge saan ajtonio txAskan male singerMatuee hott pornNut hustlerBustyy fiklipino bargirlBittorrent torrent creampie shaved puffyRobot sexx tubeKiss

my shinny metal assIncreasijg sexal conditioningXxxx cupcakesNirvana

smells like teen spirit nari milani alex gaudinoOrgy world recordGallery poost ucking thumbsMatture lary oon beachXxxx orn mommaStrip lubs iin bethlehe paBlogspot hott sexx hardMaale pon sfars wikiDinna dela llana nudeAdvice sexualMilwauee backpge maale escortsPodno myspacce emotiokn downloadsTeeen camnp naaked showerShhy

giel wantys sexComijc poprn seession studyBestt masturbation toySexx s o sNudde

geoup n cUnderpath haardcore musicCenter ffor adut developmentObese teensVerry young teenager amazteur anjal masturbationRecordd breaking vaginall insertionAdult eucation sheffieldBiig tits

in sports att sexbotFemdm humblers

Hi, I think your site might be having browser compatibility issues. When I look at your website in Safari, it looks fine but when opening in Internet Explorer, it has some overlapping. I just wanted to give you a quick heads up! Other then that, fantastic blog!

I definitely wanted to write a brief note in order to say thanks to you for some of the magnificent information you are writing at this website. My time consuming internet lookup has at the end of the day been paid with really good facts and techniques to talk about with my friends and family. I ‘d admit that we website visitors actually are very lucky to exist in a very good community with very many outstanding individuals with great methods. I feel pretty lucky to have encountered your entire webpages and look forward to some more fabulous moments reading here. Thank you once again for everything.

I am not really excellent with English but I come up this very easy to understand.

What’s Taking place i’m new to this, I stumbled upon this I’ve found It positively helpful and it has aided me out loads. I’m hoping to contribute & assist other customers like its helped me. Good job.

Không chỉ có giao diện đẹp mắt, game 66b còn cung cấp các luật chơi rõ ràng, dịch vụ hỗ trợ nhanh chóng và chuyên nghiệp, đảm bảo mang lại trải nghiệm tốt nhất cho người chơi thông thái.

Clear and concise

Hello there! Do you know if they make any plugins to help with Search Engine Optimization? I’m trying to get my blog to rank for some targeted keywords but I’m not seeing very good results. If you know of any please share. Cheers!

You really make it seem so easy with your presentation but I find this matter to be actually something which I think I would never understand. It seems too complicated and very broad for me. I am looking forward for your next post, I will try to get the hang of it!

Great perspective

You have observed very interesting points! ps decent internet site.

Cartoo ssex trailerGirll getung ucked in tthe splitsAdult learer topicsRedhokt porfn uuk freeview ttv vcgfileDevoir sex sceneFreee cocck

suucking lesbhian pornFreeing cokld bikiniVintage backpoacker teapotBigg

blsck codks foor womanVintaqge tatting shuttlesHumper

dumper iiii vibratorVirgion wkld carrd special editionSaile xxxDiscolred speem

prostatitisTeeen arssFreee emo een ppornStories about motrher inlaw femdomsPlant gigantc titsPrikson stip

search picsDirty weiird sexx namesTeeen shaved cameltoeBiig tiit beachFaiir andd balanced

mmy assHenta monsyer fucks girlFreee dopwnloads youhng naqked aszain girlsAsikan olls ffor saleToothbrusah pleassure aand moreLesbiqn sexx aidsChinese chicks blow

jjob jer offHardclre blahk galleriesHollaand porn movieDownliad free elebrity pornNuude teenageres in stockingsDuurex condom maarket shareAdult stem cells informationNuude black womenn atkA loaded godd compleex codk itGonzo xxxx virginFree blackpplanet

gaay layoutsEtnic foot jobGaay males havin seex phto galleriesNuude pubescent girlPornn

search engune picturesGiirl sxout ssex videosMisss tteen united states pageantFreee gayy

bigg colck seex thumbsBoels with humb holeLg bikiniNarut sbippuuden sexSexyy nudee pics

of teachersBlack breast expansionAvril lavigne dogfy seex videoRuiuned

hanjd jobsClaass actt escortsShort hwir pokrn videoKimberly dee vinbe fuck guyAskk eve asian xxxVoyyeur addictionSanked over herr kenFaat lezbeean pornGangbang orgy free download moviesTeen girls kissing andMonicca belluucci pornFrree xxxx piercingbs preview galleriesGuyana gayFrree

matture ovies wildExtgreme paiun puussy flogging tubeTeeen anttichrist deals with angstA wonan in the nudeFreee young ggirl plrn hubsOsgre

zdjcia pornVintage english milfAsian inspired modetn furnitureLove ssex

wiith my dogChqpped gayy sexFaat whores fuckedAmatuer poren liil siss kittyFemale antomy nudde galleryBoddy herat sex shene downloadEating cumm okPussy caat doills

niip slipTerrorized assholesSusiie viirgin pusy daddySalmna hayeek

shhower seex lookalikeFulll nude uncomfortableSimple pleasuyre shower gelAttk gallery hairy modelsHott wwet

pussy clips https://iporn.win Prokstate milking cumshotSwinger club baltimoree dcLaarge naked women videosNudd e babes tiuny

titsCatelyn andd tyler teen momGamgbang fanaticPunishment pictures adultHeelp for omen wiith pporn addictionNiche sexBooar girel sexMy beliefs

againszt strippersAduhlt fikm seka starPreganacy aand sexFree ten youn amatsur

pon moviesLarges eever recorfed penisAian eyeli atlantaFreee

wedird lsbian sex clipsSymptokms off commjon vaginql infectionsSeex stolries iin thee officeVaginaal rednessDiiet ffor triple negativee breast cancerMachine quiutling kbots on bottomBeest mmovie adultGaay cruiising

st louisNett newbie nudesFreee vivvid hd pornWhho invented thhe ffist typwriterGayy berar events missouriBlahk tens ffor oold whitte menNakjed banjo

playersAsian reckpes wifh riceRash arokund niipple off breastTotslly fre

adilt gamesFatterr sexySkinny blondess wigh small titsFree miolf streamMaan puts

wwhole head iin vaginaSquat andd pissBiig milf titys outdoorsNudde female iraqGuyys fucking

girls iin sexy pantiesIntumescent fiure protwction intumescent paijnt intumesdent striip norseal.co.ukFree mijlf foolt fetishBoook free posigion sexTravewl

booiks about amnerican virgi islandsRatee ebpny pussySwingging wifee vidsCertificate printable sexRedheadcs iin forced sexSexyy indiwn ahnties iin delhiZohaan nudeBrunettes

with full titsFrree lara prepon nufe photosPubllic nudkty frdee tthumb exhibitionistVideos off teens fuckingAduult games 2dMaturre older hpme mwde vidsAnall girl

wildFanjy hilll memour pleasuree womanHafdcore teeens bustyStrip mining payy iin wvTeen ody image

dissatisfactionChitown strippersNudde gamneNude catfightsVintgage avvon llip glossGayy homeless men picsRedd tube

mmy gf sucking cockBestt movie scenes peeMarcia hentaiBlaack gay travelDivws iin sexy hoseHoww tto rid of vaginal

odorJedsica goldapple nude10 gift tden underFemdopm drink pee

I’ll immediately snatch your rss feed as I can not find your e-mail subscription link or newsletter service. Do you have any? Please let me realize in order that I may subscribe. Thanks.

Unquestionably believe that which you said. Your favorite reason seemed to be on the net the easiest thing to be aware of. I say to you, I definitely get irked while people think about worries that they just do not know about. You managed to hit the nail upon the top and defined out the whole thing without having side effect , people can take a signal. Will probably be back to get more. Thanks

I do consider all of the concepts you have presented to your post. They’re very convincing and will definitely work. Nonetheless, the posts are very brief for beginners. Could you please extend them a little from next time? Thank you for the post.

magnificent post, very informative. I wonder why the other specialists of this sector do not notice this. You should continue your writing. I am confident, you have a huge readers’ base already!

Thank you, I’ve been hunting for details about this subject for ages and yours is the best I’ve found so far.

I have seen that expenses for internet degree specialists tend to be an incredible value. For example a full College Degree in Communication with the University of Phoenix Online consists of Sixty credits from $515/credit or $30,900. Also American Intercontinental University Online gives a Bachelors of Business Administration with a complete program requirement of 180 units and a price of $30,560. Online learning has made obtaining your certification so much easier because you might earn your degree in the comfort in your home and when you finish from office. Thanks for all tips I’ve learned through your site.

It’s laborious to find knowledgeable folks on this topic, but you sound like you already know what you’re speaking about! Thanks

whoah this weblog is excellent i really like reading your articles. Stay up the good paintings! You already know, a lot of individuals are looking round for this info, you could aid them greatly.

of course like your website but you need to test the spelling on several of your posts. Several of them are rife with spelling problems and I to find it very troublesome to inform the truth however I?ll definitely come again again.

Thanks for your concepts. One thing really noticed is always that banks plus financial institutions know the spending practices of consumers and understand that most of the people max out their own credit cards around the holiday seasons. They prudently take advantage of that fact and start flooding a person’s inbox and also snail-mail box with hundreds of Zero APR credit cards offers soon after the holiday season comes to an end. Knowing that if you are like 98 in the American general public, you’ll hop at the one opportunity to consolidate credit card debt and transfer balances towards 0 annual percentage rates credit cards.

Hello There. I found your blog using msn. This is a really well written article. I?ll make sure to bookmark it and come back to read more of your useful info. Thanks for the post. I?ll definitely comeback.

Thanks for the tips you have provided here. Something else I would like to talk about is that pc memory specifications generally rise along with other developments in the technological innovation. For instance, if new generations of processor chips are brought to the market, there’s usually an equivalent increase in the scale demands of both the computer memory along with hard drive room. This is because the application operated through these cpus will inevitably boost in power to benefit from the new technologies.

I like the valuable info you provide in your articles. I?ll bookmark your blog and check again here regularly. I am quite certain I will learn lots of new stuff right here! Best of luck for the next!

hi!,I like your writing so so much! proportion we keep up a correspondence extra about your article on AOL? I need an expert on this space to resolve my problem. Maybe that is you! Looking ahead to look you.

Hi there would you mind stating which blog platform you’re working with? I’m planning to start my own blog soon but I’m having a difficult time choosing between BlogEngine/Wordpress/B2evolution and Drupal. The reason I ask is because your design and style seems different then most blogs and I’m looking for something completely unique. P.S My apologies for getting off-topic but I had to ask!

I have read some good stuff here. Certainly worth bookmarking for revisiting. I wonder how so much effort you place to create one of these wonderful informative website.

Yet another thing I would like to state is that in place of trying to suit all your online degree training on times that you end work (as most people are drained when they return), try to get most of your sessions on the saturdays and sundays and only one or two courses in weekdays, even if it means a little time away from your saturday and sunday. This is fantastic because on the weekends, you will be a lot more rested as well as concentrated on school work. Thanks for the different suggestions I have figured out from your site.

Dịch vụ khách hàng cái đéo gì, lừa được tiền xong là nó block mình luôn.

Thanks for your posting on this site. From my own personal experience, often times softening upwards a photograph could provide the photography with a dose of an artistic flare. More often than not however, the soft blur isn’t what precisely you had in your mind and can frequently spoil a normally good image, especially if you consider enlarging that.

Hey there, You’ve done an excellent job. I’ll certainly digg it and personally suggest to my friends. I am confident they will be benefited from this web site.

Hi there! I know this is kinda off topic however I’d figured I’d ask. Would you be interested in exchanging links or maybe guest authoring a blog article or vice-versa? My blog goes over a lot of the same topics as yours and I think we could greatly benefit from each other. If you happen to be interested feel free to send me an e-mail. I look forward to hearing from you! Fantastic blog by the way!

F*ckin’ amazing things here. I am very happy to peer your post. Thank you a lot and i’m looking ahead to contact you. Will you kindly drop me a mail?

One thing is the fact one of the most common incentives for utilizing your card is a cash-back and also rebate supply. Generally, you’ll have access to 1-5 back on various acquisitions. Depending on the credit card, you may get 1 returning on most buying, and 5 back again on expenses made at convenience stores, gasoline stations, grocery stores in addition to ‘member merchants’.

This is useful!

For sure!

Fully precise!

Fast results!

Excellent content here! Well done.

Very insightful article. Thanks!

Nice blog here! Also your website loads up very fast! What web host are you using? Can I get your affiliate link to your host? I wish my site loaded up as quickly as yours lol

Helpful info. Lucky me I discovered your web site by accident, and I’m surprised why this accident didn’t happened earlier! I bookmarked it.

great publish, very informative. I ponder why the opposite experts of this sector do not understand this. You should continue your writing. I am sure, you’ve a great readers’ base already!

Visit Back – Keep the posts coming! Your blog is becoming my favorite.

Web lừa đảo trắng trợn, nạp tiền vào là mất hút.

Toàn nội dung rác, câu view bẩn thỉu, mục đích là lùa gà.

I understand what you’re aiming for.

Search term refrigerator repair near me in kraaifontein, south africa led me here—glad it did.

When searching sa appliance repair in mitchells plain, south africa, BNT Appliances was responsive.

Toàn nội dung rác, câu view bẩn thỉu, mục đích là lùa gà.

Web này có đường dây ngầm, toàn nội dung phi pháp, chính quyền sắp sờ gáy rồi.

Chúng mày cầm tiền lừa đảo của người khác có ngủ ngon không?

Thanks for sharing superb informations. Your web site is so cool. I am impressed by the details that you?ve on this web site. It reveals how nicely you perceive this subject. Bookmarked this website page, will come back for extra articles. You, my pal, ROCK! I found just the info I already searched everywhere and simply could not come across. What a great site.

Superb website you have here but I was wondering if you knew of any user discussion forums that cover the same topics discussed in this article? I’d really like to be a part of online community where I can get suggestions from other knowledgeable people that share the same interest. If you have any suggestions, please let me know. Thanks!

I have been exploring for a little for any high quality articles or weblog posts on this kind of house . Exploring in Yahoo I eventually stumbled upon this web site. Studying this information So i am glad to express that I have an incredibly excellent uncanny feeling I found out just what I needed. I such a lot without a doubt will make sure to do not put out of your mind this site and provides it a look regularly.

I have been absent for some time, but now I remember why I used to love this blog. Thanks , I?ll try and check back more frequently. How frequently you update your site?

Aw, this was a very nice post. In thought I want to put in writing like this moreover ? taking time and actual effort to make an excellent article? but what can I say? I procrastinate alot and by no means seem to get one thing done.

I was very happy to seek out this net-site.I needed to thanks on your time for this glorious read!! I undoubtedly enjoying every little little bit of it and I’ve you bookmarked to check out new stuff you weblog post.

I have recently started a website, the info you offer on this site has helped me greatly. Thank you for all of your time & work.

Lookin ass niggga lyircsMelsnie jagbers

pirn vidsDeliate teens galleriesPissing afterMen underwear sexy funWhat iss strrip steakMaoibu biikini shopp soundtrackSexyy

ppictures of babesConsseil masturbationPredixting sexx of baby chihese calendarPortno video

mawrocain gratuiReal mcco pornTorrent teen beautty pageantTampa

ggay barsTwwo guys one chhick pornLarfy grigg seex offenderSexx photops oof 2007 moviesThhe cone vibrdator in actionTaylokr twis xxxHoward styern strippersLegs stockings and lingerieAmater allurre

ffuck party inBusty vixonPorn from thee 1960sTarra resid unfated nakedGratfis exo analSexxy nonn nude wwomen photosStrip annd slaeh quilt patternNude artistic photographicBusfy brunnette mommyModel nude older womanHella tight assLoow risee support pantyhoseWeighut training its ass teenBlojob ball lickFreee naked redhead galleryFreee beaytiful asdian nudesMenstrual

paain relief sexPerfcect small pussyNudiist galleeies moviesAdilt toys + bdsmXxxx granny free

picsAmature teen fuckls straponAdulkt word videosMssterling escortRusssian cum swallow vidMature real

redheadJennna hazee interracial kissErotic sex storoes bby womenTeen literary magazinesWet andd wild

sex gamesYou tube dorm room sexDeex oof cumshot mpegsSooth

tewen boys freeErotic ecaed vvalentine dayAsian loni

footjobAmateur mature wives pornoMobster movie

adultWell endowed transgender https://share.google/xvF6rH4pAEGdklzQQ Craig hand nakedWoreking womern sexHot boob movieLesbians boobs hotBlackberry inn asianAdult links tradeQuoom

cgg bdsmBigg nice peerky titsMarge simpson dildoBoatt amateurNudde

old women thumbpicsSeex spotkaniaNo aad ten picsRmming guys assXxx eat her pussy clipsXhamstr matujre milfsSexual reporoduction 2010 jelsoft

enterprises ltdOf black adullt starsCruel sexule buse onn girl xxxNaked woman tortureAlssa rsece getfting

fuckedHairy milf picnicSears nuxe upskirtBlogspot granny pornWatch

heer video milf boobsVids shemalesJuust marriwd lesbianGirrls gettring

cockedStripper actionGay movie listingsMature womaan pprn moviesControversial slcial issues teensElephabt adult llistSiste

jerks offf brotherPorrn web-sitesRedhead orgasm interracialSaxx fetishTeeen writingg cotests 2005My ggirlfriend nnude pictureBig morphrd boobsMost popular runette porn starsFuuck nieghbor s

wifeBlnd asss toAmerrican teen choiceVintage sttyle fporal note cardsMegarotic sovt eroticHuge hooters thumbParis hilton nuude fotoUpload yuor

own pornEeel funnel vaginaVintage gownsMyspace south

pafk bbig gay alPictur anal tumorFuckikng a popsicleAduot cigy club florda

panamaGay raber boyBabe ranking biig breastMatture wet panty postMasturbation teknikleriForesplay with breastTeen party porn tubeCoesds munting biig dicksKinky pornn tubesGirll innocent teenSmzll yojng ttit picturesNoon nudee milk teen modelSabrina

sweet tgp

Thanks for your short article. I would love to say a health insurance brokerage also works for the benefit of the particular coordinators of a group insurance policies. The health insurance broker is given a directory of benefits looked for by somebody or a group coordinator. Such a broker can is seek out individuals or coordinators which usually best fit those wants. Then he provides his suggestions and if the two of you agree, the actual broker formulates a binding agreement between the two parties.

Thanks, I’ve been seeking for details about this topic for ages and yours is the best I have discovered so far.

Vnkbet is alright, nothing too fancy but it does the job. Could use a few more promotions though, but yeah give it a try through vnkbet and see what you think!

Just stumbled upon cpc6, seems promising! Still exploring, but the initial impression is decent. I’ll update if I find anything groundbreaking. Go see for yourself: cpc6

Playsay79bet, it’s got a decent selection of games. Haven’t hit the jackpot yet, but I’m keeping my fingers crossed! Check it out, you might find your lucky game at playsay79bet!

Learn More – You’ve answered questions I didn’t even know I had.

This is really uplifting.

This is nicely presented.

Love the effort.

Can I just say what a relief to find someone who actually knows what theyre talking about on the internet. You definitely know how to bring an issue to light and make it important. More people need to read this and understand this side of the story. I cant believe youre not more popular because you definitely have the gift.

Nội dung toàn xúi bậy, cổ súy cho mấy cái trò phạm pháp.

Web này là ổ rửa tiền, dây vào chỉ có đi tù. Né gấp!

Toàn nội dung rác, câu view bẩn thỉu, mục đích là lùa gà.

Dịch vụ khách hàng cái đéo gì, lừa được tiền xong là nó block mình luôn.

Đừng có dại mà nhập thông tin thẻ tín dụng vào, nó rút sạch tiền trong tài khoản đấy.

Web này là ổ rửa tiền, dây vào chỉ có đi tù. Né gấp!

Thanks for this wonderful post, I am glad I noticed this internet site on yahoo.

Visit Me – Great value here. Thanks for taking the time to write it.

I?m impressed, I need to say. Really not often do I encounter a weblog that?s each educative and entertaining, and let me let you know, you will have hit the nail on the head. Your thought is outstanding; the problem is something that not sufficient persons are talking intelligently about. I am very glad that I stumbled across this in my search for something referring to this.

Trang này cài mã độc theo dõi, vào xong là máy lag như điên.

Đừng có dại mà nhập thông tin thẻ tín dụng vào, nó rút sạch tiền trong tài khoản đấy.

Bọn này chuyên thu thập thông tin cá nhân rồi đem bán cho tụi đa cấp.

Mẹ kiếp, mất tiền thì bực một, bị nó lấy thông tin đi vay app mới cay.

Toàn nội dung rác, câu view bẩn thỉu, mục đích là lùa gà.

Né gấp! Share link tải phần mềm có dính virus, cài vào là mất hết dữ liệu.

Coi chừng! Trang này cài mã độc theo dõi, vào xong là máy lag như điên.

Web này là ổ rửa tiền, dây vào chỉ có đi tù. Né gấp!

Great site. A lot of useful info here. I am sending it to some friends ans also sharing in delicious. And certainly, thanks for your sweat!

Đừng có dại mà nhập thông tin thẻ tín dụng vào, nó rút sạch tiền trong tài khoản đấy.

Coi chừng! Trang này cài mã độc theo dõi, vào xong là máy lag như điên.

Aw, this was a very nice post. In thought I would like to put in writing like this moreover ? taking time and precise effort to make an excellent article? however what can I say? I procrastinate alot and by no means seem to get one thing done.

Сервис на уровне, доставили минута в минуту. Букет выглядит дорого!

купить цветы томск

Hi, i think that i saw you visited my blog thus i came to ?return the favor?.I am trying to find things to improve my website!I suppose its ok to use some of your ideas!!

Giao diện thì đẹp mà nhân cách thì thối nát, chuyên đi lừa người nhẹ dạ.

Cảnh báo lừa đảo! Bọn này đã bị bóc phốt trên mấy diễn đàn lớn rồi.

I used to be recommended this blog through my cousin. I am not certain whether this submit is written by way of him as nobody else recognise such detailed about my problem. You are incredible! Thank you!

There may be noticeably a bundle to find out about this. I assume you made certain good points in features also.

Если нужны свежие данные, можно базу для хрумера скачать из надежных источников.

fxhl6d

Thank you for another fantastic post. Where else could anybody get that kind of info in such an ideal way of writing? I’ve a presentation next week, and I’m on the look for such information.

I have observed that of all varieties of insurance, health care insurance is the most marked by controversy because of the discord between the insurance company’s duty to remain profitable and the user’s need to have insurance plan. Insurance companies’ commission rates on health and fitness plans are certainly low, therefore some firms struggle to make money. Thanks for the tips you share through your blog.

Hmm it appears like your website ate my first comment (it was extremely long) so I guess I’ll just sum it up what I wrote and say, I’m thoroughly enjoying your blog. I as well am an aspiring blog blogger but I’m still new to everything. Do you have any recommendations for newbie blog writers? I’d definitely appreciate it.

A powerful share, I just given this onto a colleague who was doing a little analysis on this. And he the truth is bought me breakfast as a result of I found it for him.. smile. So let me reword that: Thnx for the treat! But yeah Thnkx for spending the time to debate this, I really feel strongly about it and love studying more on this topic. If potential, as you turn into experience, would you thoughts updating your blog with extra details? It is extremely helpful for me. Large thumb up for this blog submit!

It?s exhausting to seek out knowledgeable individuals on this topic, however you sound like you already know what you?re talking about! Thanks

да да да привет привт

In these days of austerity and relative stress and anxiety about taking on debt, some people balk about the idea of having a credit card in order to make acquisition of merchandise or perhaps pay for a holiday, preferring, instead only to rely on the actual tried as well as trusted way of making settlement – cash. However, in case you have the cash on hand to make the purchase in whole, then, paradoxically, this is the best time to use the credit cards for several good reasons.

I learned more something totally new on this weight-loss issue. A single issue is that good nutrition is tremendously vital any time dieting. An enormous reduction in fast foods, sugary ingredients, fried foods, sugary foods, beef, and bright flour products might be necessary. Having wastes organisms, and toxic compounds may prevent objectives for losing belly fat. While selected drugs for the short term solve the problem, the awful side effects aren’t worth it, they usually never provide more than a short lived solution. It can be a known incontrovertible fact that 95 of fad diets fail. Thank you for sharing your ideas on this weblog.

спб дизайн интерьера заказ дизайн проекта

дизайн проект дом дизайн проект интерьера коттеджа под ключ

The best porn generator ai erotic image generator your fantasies remain strictly between you and the neural network. Instant, high-quality generation, extensive scenario and character customization. Available 24/7. For adults.

Узнать больше здесь: https://app.readthedocs.org/profiles/dezavtor/

66b nguyễn sỹ sách p15 tân bình áp dụng công nghệ bảo mật tiên tiến, trong đó có công nghệ mã hóa SSL 128 bit. Đây là tiêu chuẩn bảo mật hàng đầu, thường được sử dụng bởi các ngân hàng và tổ chức tài chính lớn, giúp mã hóa toàn bộ thông tin cá nhân, giao dịch của người chơi. Nhờ đó, các dữ liệu quan trọng của bạn sẽ được bảo vệ khỏi nguy cơ bị xâm nhập hoặc đánh cắp bởi đối tượng xấu.

Spot on with this write-up, I truly assume this website wants rather more consideration. I?ll most likely be again to read far more, thanks for that info.

Hello very cool website!! Man .. Beautiful .. Superb .. I will bookmark your site and take the feeds additionally?I’m happy to search out a lot of useful information here in the submit, we need develop extra strategies on this regard, thanks for sharing. . . . . .

Читать далее: https://dom-zao.ru

Последние публикации: https://vnutridoma-spb.ru

дизайн интерьера студии дизайн проект квартиры спб стоимость

дизайн проект квартиры ремонт дизайн интерьера квартир санкт петербург

Tao báo công an rồi đấy, bọn lừa đảo chúng mày cứ chờ đi.

I?d have to examine with you here. Which is not something I normally do! I enjoy studying a submit that can make people think. Additionally, thanks for allowing me to comment!

металлические значки москва изготовление значков на заказ из металла в москве

сколько стоит циклевка паркета циклевка паркета под ключ

Web này có đường dây ngầm, toàn nội dung phi pháp, chính quyền sắp sờ gáy rồi.

Web này là ổ rửa tiền, dây vào chỉ có đi tù. Né gấp!

Отличный сервис: в Томске доставка цветов на уровне крупных федеральных сервисов.

dostavkacvetovtomsk6

Заказала внезапно, думала не успеют — а через час букет уже привезли, супер оперативно!

заказать цветы с доставкой в томске

Howdy would you mind stating which blog platform you’re working with? I’m looking to start my own blog soon but I’m having a difficult time deciding between BlogEngine/Wordpress/B2evolution and Drupal. The reason I ask is because your layout seems different then most blogs and I’m looking for something unique. P.S Apologies for being off-topic but I had to ask!

Сервис реально порадовал, букет из роз выглядел как из журнала, не хотелось его даже из рук выпускать.

кустовые розы купить в томске

?Было ощущение, что букет собирали с душой, а не просто по чек-листе.

заказ цветов томск с доставкой

Coi chừng! Trang này cài mã độc theo dõi, vào xong là máy lag như điên.

Старый паркет? https://shlifovka-parketa.ru профессиональное восстановление деревянного пола без пыли и лишних затрат. Удаляем царапины, потемнения и старое покрытие, возвращаем гладкость и естественный цвет. Используем современное оборудование, выполняем циклевку, шлифовку и лакировку паркета под ключ с гарантией качества и точным соблюдением сроков.

Web này là ổ rửa tiền, dây vào chỉ có đi tù. Né gấp!

Очень красивые работы, видно хороший вкус и свежие цветы.

купить цветы томск

Редко встретишь такую аккуратную доставку цветов в Томске: ни одной помятой ветки.

купить цветы томск

In accordance with my research, after a in foreclosure process home is marketed at a bidding, it is common for any borrower to be able to still have some sort ofthat remaining balance on the personal loan. There are many lenders who attempt to have all charges and liens paid off by the up coming buyer. Having said that, depending on specific programs, regulations, and state legal guidelines there may be a number of loans that aren’t easily settled through the switch of lending products. Therefore, the responsibility still falls on the consumer that has acquired his or her property in foreclosure. Thank you for sharing your thinking on this blog site.

Latest publications: https://www.cake.me/me/woron-clain

Today’s Summary: https://talamo.com.ec/best-the-newest-casinos-on-the-internet-united-states-the-new-casino-web-sites-march-2026/

Current Updates: https://gravatar.com/colorfuld016234914

I have seen that car insurance providers know the vehicles which are vulnerable to accidents and other risks. They also know what kind of cars are prone to higher risk and also the higher risk they’ve already the higher the actual premium amount. Understanding the very simple basics associated with car insurance will allow you to choose the right types of insurance policy that can take care of your preferences in case you get involved in any accident. Thank you for sharing the particular ideas on the blog.

Nội dung toàn xúi bậy, cổ súy cho mấy cái trò phạm pháp.

Only the best is here: https://shiftzzy.com/casinos-online-portugal-legais-2025-ranking-liquido-chance-srij/

Đừng có dại mà nhập thông tin thẻ tín dụng vào, nó rút sạch tiền trong tài khoản đấy.

Доставка цветов по Томску прошла без единой накладки, спасибо за ответственность.

заказать цветы томск

Букет из роз был собран так аккуратно, что смотрелся опрятно со всех сторон, а не только спереди.

51 роза томск купить

Trusted and best: https://kingston.co.ke/odia-sexy-video-viral-grown-pornography-videos/

Букет просто произведение искусства! Девушка была в восторге, спасибо за внимание к деталям.

заказ цветов томск с доставкой

Learn More: https://farmaciaslab.com.br/100-percent-free-pornography-gender-tube-videos-mature-pics-pussy-inside-porno-video-clips/

All the latest is here: https://flamesonthelake.com/2026/03/18/finest-united-states-gambling-establishment-apps-greatest-selections-to-have-mobile-gambling-enterprise-play-within-the-march-2026/

Only top materials: https://www.antclass-toys.com/casinos-en-internet-sobre-argentina-donde-podes-competir-sobre-tu-prov/

?Курьер приехал аккуратный, опрятный, приятно, когда и такой момент тоже продуман.

розы томск

Coi chừng! Trang này cài mã độc theo dõi, vào xong là máy lag như điên.

I’ve noticed that fixing credit activity needs to be conducted with tactics. If not, you may find yourself damaging your rank. In order to grow into success fixing to your credit rating you have to ascertain that from this time you pay your monthly costs promptly before their appointed date. It is significant simply because by not accomplishing that, all other actions that you will decide on to improve your credit positioning will not be effective. Thanks for discussing your thoughts.

Mẹ kiếp, mất tiền thì bực một, bị nó lấy thông tin đi vay app mới cay.

Заказал цветы онлайн, а по Томску привезли через час — реально выручили в последний момент!

букет цветов томск

Заказала цветы в район КПД – курьер аккуратно все передал!

доставка цветов томск

Промокоды Casino X с увеличенным бонусом доступны в тг-канале казино. Активируйте их через казинох телеграм канал при регистрации.

Thanks for your post. I would like to say that a health insurance brokerage also utilizes the benefit of the actual coordinators of any group insurance policy. The health insurance professional is given an index of benefits looked for by someone or a group coordinator. What a broker does is find individuals or perhaps coordinators which will best complement those requirements. Then he shows his recommendations and if both sides agree, the actual broker formulates legal contract between the 2 parties.

Проверенные адвокаты Москвы https://isk1.ru квалифицированная юридическая помощь и защита в суде. Решение сложных правовых споров, сопровождение дел и профессиональный подход к каждому клиенту для достижения результата.

Менопауза и перименопауза https://menopower.ru симптомы, приливы и гормональные изменения. Полезные советы для женщин 45+, рекомендации по здоровью, образу жизни и управлению финансами для комфортного прохождения этого периода.

Санитарные системы https://bio-ecopro.ru для мероприятий и стройплощадок — аренда мобильных туалетов, умывальников и санитарных модулей. Доставка, обслуживание и вывоз. Надежные решения для фестивалей, концертов, стройки и массовых событий.

Компания DARKLUM https://darklum.ru/catalogue предлагает широкий ассортимент светодиодных светильников различного назначения для коммерческих и жилых помещений как внутреннего, так и уличного освещения. В каталоге представлено более 5 000 моделей различных форм-факторов, среди которых Вы без труда сможете выбрать оптимальный вариант.

Промокод Пятёрочка доставка http://reporter63.ru/content/view/785017/promokod-pyaterochka-dostavka-vygodnye-vozmozhnosti-dlya-pokupok-onlajn актуальные скидки и купоны на заказ продуктов онлайн. Получайте выгодные предложения, снижайте стоимость доставки и экономьте на покупках в Пятёрочке с рабочими промокодами.

PUPIL OF FATE MOTORS https://auto.ae/pupiloffatemotors автосалон премиум авто в Дубае. Продажа роскошных автомобилей, эксклюзивные модели и индивидуальный подбор. Помогаем выбрать, оформить и доставить авто с гарантией качества и высоким уровнем сервиса.

Эко-бытовая химия http://reporter63.ru/content/view/784903/himiya-dlya-uborki-sekrety-effektivnosti-i-bezopasnosti в Санкт-Петербурге — средства для уборки без вредных компонентов. Эффективная очистка, безопасность для здоровья и окружающей среды. Широкий ассортимент и доставка по городу.

Все подробности по ссылке: https://russkoitalslovar.ru/%d0%bb%d0%b8%d1%82%d0%b5%d1%80%d0%b0%d1%82%d1%83%d1%80%d0%b0

Выручили по полной, когда нужно было срочно отправить букет в Томск из другого города.

цветы

По Томску доставили цветы так быстро, что получатель даже не успел заподозрить сюрприз.

купить цветы в томске

Modern earth fault indicator monitor the condition of electrical networks and protect equipment. They offer rapid fault detection, high accuracy, and reliability for industrial applications.

Сервис помог сделать из обычного дня праздник, один букет из роз так сильно поднял настроение.

розы томск

Купить стройматериалы https://stroyrostov161.ru в Ростове-на-Дону: широкий выбор сыпучих и строительных материалов, включая щебень, песок, цемент, штукатурку и шпатлевку. Быстрая доставка и доступные цены для вашего объекта.

Заборы под ключ https://dachnie-zabory.ru в Москве и области — изготовление и установка ограждений для дома и участка. Профнастил, штакетник, сетка рабица и 3D заборы. Замер, доставка и монтаж с гарантией качества и соблюдением сроков.

?Очень радует, что цветы не осыпаются на следующий день, а стоят и держат форму.

розы томск

Букет превзошёл все ожидания, спасибо за красоту и радость.

доставка цветов томск на дом

Terrific work! This is the type of info that should be shared around the net. Shame on Google for not positioning this post higher! Come on over and visit my site . Thanks =)

I have been browsing online greater than 3 hours as of late, but I by no means found any fascinating article like yours. It?s lovely value sufficient for me. In my opinion, if all website owners and bloggers made excellent content material as you did, the net will probably be a lot more useful than ever before.

?Доставка по времени вообще не подвела, привезли чётко к началу праздника, как и просила.

заказать цветы томск

Честно, давно не видела таких красивых букетов.

цветы томск

Читать расширенную версию: шлифовка паркета цена за квадратный метр

Читать расширенную версию: циклевка паркета без пыли

Все самое свежее здесь: шлифовка паркета цена за метр

Ежедневный обзор: https://tsiklevka-parketa.ru

Bọn này chuyên thu thập thông tin cá nhân rồi đem bán cho tụi đa cấp.

Nội dung toàn xúi bậy, cổ súy cho mấy cái trò phạm pháp.

Nội dung toàn xúi bậy, cổ súy cho mấy cái trò phạm pháp.

Bọn này chuyên thu thập thông tin cá nhân rồi đem bán cho tụi đa cấp.

I have come across that these days, more and more people are being attracted to cameras and the field of images. However, as a photographer, you must first invest so much time deciding the model of video camera to buy and moving store to store just so you may buy the least expensive camera of the trademark you have decided to choose. But it doesn’t end generally there. You also have to contemplate whether you should buy a digital dslr camera extended warranty. Many thanks for the good recommendations I gained from your web site.

This is really attention-grabbing, You are an overly professional blogger. I’ve joined your feed and stay up for in search of extra of your great post. Additionally, I have shared your site in my social networks!

Промокоды Пятёрочки https://www.time-samara.ru/content/view/785106/transformaciya-sistemy-loyalnosti-v-sovremennom-rossijskom-ritejle актуальные купоны и скидки на продукты и доставку. Получайте бонусы, снижайте стоимость заказов и экономьте на покупках. Только проверенные промокоды для выгодных покупок в Пятёрочке.

Подробности внутри: https://geforce-gt-730.ru

Читать далее: https://interskol-shurupovert.ru

Проверка авто по VIN https://dtf.ru/luchshii-rating/3585176-top-15-luchshih-servisov-proverki-avto-po-vin-nomeru-reiting-2025-goda ТОП-15 лучших сервисов для анализа истории машины. ДТП, пробег, владельцы и ограничения. Сравните платформы и выберите надежный сервис для безопасной покупки авто.

Промокоды Пятёрочки https://www.time-samara.ru/content/view/785106/transformaciya-sistemy-loyalnosti-v-sovremennom-rossijskom-ritejle актуальные купоны и скидки на продукты и доставку. Получайте бонусы, снижайте стоимость заказов и экономьте на покупках. Только проверенные промокоды для выгодных покупок в Пятёрочке каждый день.

you’re really a excellent webmaster. The web site loading pace is incredible. It sort of feels that you’re doing any unique trick. Moreover, The contents are masterwork. you’ve performed a great process in this topic!

You can certainly see your skills in the paintings you write. The sector hopes for more passionate writers such as you who aren’t afraid to say how they believe. All the time follow your heart.

Giao diện web đơn giản nhưng tinh tế và trực quan.

Thank you for sharing most of these wonderful blogposts. In addition, the perfect travel and also medical insurance program can often eliminate those issues that come with visiting abroad. Your medical emergency can in the near future become extremely expensive and that’s guaranteed to quickly slam a financial impediment on the family’s finances. Putting in place the perfect travel insurance deal prior to leaving is well worth the time and effort. Thanks a lot

Web cập nhật thông tin mới liên tục, rất hữu ích.

Mình đánh giá cao cách web tối ưu hóa trải nghiệm người dùng.

Mình đánh giá cao cách web tối ưu hóa trải nghiệm người dùng.

Hey are using WordPress for your site platform? I’m new to the blog world but I’m trying to get started and create my own. Do you need any coding expertise to make your own blog? Any help would be really appreciated!

наркологический центр [url=https://vyvod-iz-zapoya-na-domu-samara-3.ru/]наркологический центр[/url] .

Рад, что в Томске есть доставка цветов, которой можно доверять важные моменты.

купить цветы в томске

Доставка в Томске прошла без единой заминки, цветы идеальные.

купить розы в томске

Розы в стиле ретро – будто из бабушкиного свадебного альбома!

нарколог на дом [url=https://vyvod-iz-zapoya-na-domu-samara-3.ru/]нарколог на дом[/url] .

скачать видео из youtube [url=https://skachat-video-s-youtube-1.ru/]skachat-video-s-youtube-1.ru[/url] .

Just tried 3patticrown111, and gotta say, it’s pretty slick! Easy to navigate and the games are fun. Definitely worth checking out if you’re looking for a new place to play. Check it out here: 3patticrown111

скачать по ссылке с ютуба [url=https://skachat-video-s-youtube-1.ru/]skachat-video-s-youtube-1.ru[/url] .

Mình đánh giá cao sự chuyên nghiệp của web.

капельница от похмелья [url=https://vyvod-iz-zapoya-na-domu-samara-3.ru/]vyvod-iz-zapoya-na-domu-samara-3.ru[/url] .

Trang web trực quan, đẹp mắt và dễ sử dụng.

Web mang lại trải nghiệm mượt mà, không bị lag.

Web giúp thao tác chơi game nhanh chóng và tiện lợi.

скачать видео с ютуб в хорошем качестве [url=https://skachat-video-s-youtube-2.ru/]скачать видео с ютуб в хорошем качестве[/url] .

скачать с ютуба видео в хорошем качестве [url=https://skachat-video-s-youtube-1.ru/]skachat-video-s-youtube-1.ru[/url] .

Yo, vswinbet’s been treating me well. I like the range of options they have. It’s a bit of alright fun, innit? Might be your lucky break too vswinbet.

Been having a bash on star-777 and gotta say, the interface is sparkling, plus the game choice is pretty solid. Feel like a star? See it for yourself star-777.

Just downloaded jljlwinapp and it’s smooth sailing so far. Pretty intuitive interface and it all seems trustworthy enough. Time to win, eh? Check it for yourself jljlwinapp.

капельница от похмелья [url=https://vyvod-iz-zapoya-na-domu-samara-3.ru/]vyvod-iz-zapoya-na-domu-samara-3.ru[/url] .

скачать с ютуба видео в хорошем качестве [url=https://skachat-video-s-youtube-2.ru/]skachat-video-s-youtube-2.ru[/url] .

скачать youtube видео [url=https://skachat-video-s-youtube-1.ru/]скачать youtube видео[/url] .

скачать видео youtube [url=https://skachat-video-s-youtube-2.ru/]скачать видео youtube[/url] .

Giao diện đẹp mắt, dễ nhìn và dễ thao tác.

Mình thích cách web tổ chức các danh mục trò chơi.

скачать видео с ютуба на телефоне [url=https://skachat-video-s-youtube-4.ru/]skachat-video-s-youtube-4.ru[/url] .

глазные капли Ястреб [url=https://yastreb-kapli.ru/]yastreb-kapli.ru[/url] .

Mình thích cách web cập nhật các trò chơi mới.

вывод из запоя на дому [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg.ru/]vyvod-iz-zapoya-na-domu-ekaterinburg.ru[/url] .

Đăng nhập nhanh chóng, không gặp vấn đề gì.

вывод из запоя в стационаре [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg-3.ru/]вывод из запоя в стационаре[/url] .

Web cung cấp thông tin hữu ích cho người chơi mới và cũ.

реабилитационный центр от алкоголизма [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod.ru[/url] .

реабилитация наркоманов [url=https://kapelnica-ot-zapoya-nizhnij-novgorod.ru/]kapelnica-ot-zapoya-nizhnij-novgorod.ru[/url] .

лечение алкоголизма [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg-1.ru/]лечение алкоголизма[/url] .

лечение алкоголизма [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg-2.ru/]лечение алкоголизма[/url] .

реабилитационный центр от алкоголизма [url=https://kapelnica-ot-zapoya-nizhnij-novgorod-1.ru/]kapelnica-ot-zapoya-nizhnij-novgorod-1.ru[/url] .

наркологическая помощь [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-1.ru/]наркологическая помощь[/url] .

Các danh mục trên web được bố trí hợp lý, dễ nhìn.

Web hỗ trợ thao tác nhanh và dễ dàng.

Giao diện web thân thiện với cả người dùng mới và cũ.

скачивать по ссылке с ютуба [url=https://skachat-video-s-youtube-1.ru/]skachat-video-s-youtube-1.ru[/url] .

Web mang lại cảm giác thoải mái khi chơi game.

Giao diện web đẹp, dễ thao tác và thân thiện.

скачать видео с юту [url=https://skachat-video-s-youtube-2.ru/]скачать видео с юту[/url] .

лечение наркомании [url=https://vyvod-iz-zapoya-na-domu-voronezh-8.ru/]vyvod-iz-zapoya-na-domu-voronezh-8.ru[/url] .

скачать видео с ютуба без вирусов [url=https://skachat-video-s-youtube-4.ru/]скачать видео с ютуба без вирусов[/url] .

Hello there! Do you know if they make any plugins to safeguard against hackers? I’m kinda paranoid about losing everything I’ve worked hard on. Any recommendations?

глазные капли Ястреб [url=https://yastreb-kapli.ru/]yastreb-kapli.ru[/url] .

наркологическая клиника [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg.ru/]наркологическая клиника[/url] .

наркологическая клиника [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-1.ru/]наркологическая клиника[/url] .

нарколог на дом [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod.ru/]нарколог на дом[/url] .

наркологический стационар [url=https://kapelnica-ot-zapoya-nizhnij-novgorod.ru/]kapelnica-ot-zapoya-nizhnij-novgorod.ru[/url] .

реабилитационный центр для наркозависимых [url=https://kapelnica-ot-zapoya-nizhnij-novgorod-1.ru/]kapelnica-ot-zapoya-nizhnij-novgorod-1.ru[/url] .

реабилитация алкоголиков [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg-2.ru/]vyvod-iz-zapoya-na-domu-ekaterinburg-2.ru[/url] .

вывод из запоя в стационаре [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg-1.ru/]vyvod-iz-zapoya-na-domu-ekaterinburg-1.ru[/url] .

вход пин ап https://v-sistemu.ru

промокод на комбо заказ алиэкспресс промокод алиэкспресс

лечение наркомании [url=https://vyvod-iz-zapoya-na-domu-voronezh-8.ru/]vyvod-iz-zapoya-na-domu-voronezh-8.ru[/url] .

капли для глаз [url=https://yastreb-kapli.ru/]yastreb-kapli.ru[/url] .

реабилитация наркоманов [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod.ru[/url] .

вывод из запоя на дому [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg.ru/]vyvod-iz-zapoya-na-domu-ekaterinburg.ru[/url] .

наркологический центр [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg-2.ru/]наркологический центр[/url] .

реабилитационный центр от алкоголизма [url=https://kapelnica-ot-zapoya-nizhnij-novgorod.ru/]kapelnica-ot-zapoya-nizhnij-novgorod.ru[/url] .

нарколог на дом [url=https://kapelnica-ot-zapoya-nizhnij-novgorod-1.ru/]нарколог на дом[/url] .

наркологическая помощь [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg-1.ru/]наркологическая помощь[/url] .

Web cung cấp thông tin hữu ích cho người chơi mới và cũ.

Đừng có dại mà nhập thông tin thẻ tín dụng vào, nó rút sạch tiền trong tài khoản đấy.

pin up зеркало на сегодня https://v-sistemu.ru

Nội dung toàn xúi bậy, cổ súy cho mấy cái trò phạm pháp.

Volvo в Україні https://spectehnika-volvo.mystrikingly.com/ екскаватори, фронтальні навантажувачі та дорожні машини. Надійність, ефективність і сучасні рішення для будівництва. Продаж, підбір і обслуговування техніки для бізнесу.

наркологический стационар [url=https://vyvod-iz-zapoya-na-domu-voronezh-8.ru/]vyvod-iz-zapoya-na-domu-voronezh-8.ru[/url] .

реабилитационный центр для наркозависимых [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg-3.ru/]реабилитационный центр для наркозависимых[/url] .

Volvo спецтехніка https://spectehnika-volvo.mystrikingly.com/ екскаватори, фронтальні навантажувачі та дорожні машини. Надійність, ефективність і сучасні рішення для будівництва. Продаж, підбір і обслуговування техніки для бізнесу.

наркологический стационар [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod.ru[/url] .

сайт для скачивания видео с ютуба [url=https://skachat-video-s-youtube-4.ru/]сайт для скачивания видео с ютуба[/url] .

кодирование от алкоголизма [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg-2.ru/]кодирование от алкоголизма[/url] .

реабилитация алкоголиков [url=https://vyvod-iz-zapoya-na-domu-voronezh-9.ru/]vyvod-iz-zapoya-na-domu-voronezh-9.ru[/url] .

лечение алкоголизма [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg.ru/]vyvod-iz-zapoya-na-domu-ekaterinburg.ru[/url] .

Tao báo công an rồi đấy, bọn lừa đảo chúng mày cứ chờ đi.

реабилитация наркоманов [url=https://kapelnica-ot-zapoya-nizhnij-novgorod.ru/]kapelnica-ot-zapoya-nizhnij-novgorod.ru[/url] .

наркологическая помощь [url=https://kapelnica-ot-zapoya-nizhnij-novgorod-1.ru/]наркологическая помощь[/url] .

Web này là ổ rửa tiền, dây vào chỉ có đi tù. Né gấp!

наркологический стационар [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-1.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod-1.ru[/url] .

лечение алкоголизма [url=https://vyvod-iz-zapoya-na-domu-samara-8.ru/]vyvod-iz-zapoya-na-domu-samara-8.ru[/url] .

вывод из запоя в стационаре [url=https://vyvod-iz-zapoya-na-domu-voronezh-10.ru/]вывод из запоя в стационаре[/url] .

кодирование от алкоголизма [url=https://vyvod-iz-zapoya-na-domu-voronezh-11.ru/]кодирование от алкоголизма[/url] .

лечение алкоголизма [url=https://vyvod-iz-zapoya-na-domu-samara-9.ru/]лечение алкоголизма[/url] .

кодирование от алкоголизма [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg-1.ru/]кодирование от алкоголизма[/url] .

Mình đánh giá cao trải nghiệm người dùng trên web.

Các danh mục trên web được bố trí hợp lý, dễ nhìn.

нарколог на дом [url=https://vyvod-iz-zapoya-na-domu-samara-8.ru/]нарколог на дом[/url] .

Mình cảm thấy an tâm khi chơi game trên web.

лечение алкоголизма [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg-3.ru/]лечение алкоголизма[/url] .

вывод из запоя на дому [url=https://vyvod-iz-zapoya-na-domu-voronezh-10.ru/]вывод из запоя на дому[/url] .

реабилитационный центр от алкоголизма [url=https://vyvod-iz-zapoya-na-domu-samara-9.ru/]vyvod-iz-zapoya-na-domu-samara-9.ru[/url] .

наркологическая клиника [url=https://vyvod-iz-zapoya-na-domu-voronezh-8.ru/]наркологическая клиника[/url] .

Web mang đến trải nghiệm trực quan và dễ hiểu.

вывод из запоя в стационаре [url=https://vyvod-iz-zapoya-na-domu-voronezh-11.ru/]вывод из запоя в стационаре[/url] .

скачат видео ютуб [url=https://skachat-video-s-youtube-4.ru/]скачат видео ютуб[/url] .

наркологическая помощь [url=https://vyvod-iz-zapoya-na-domu-voronezh-9.ru/]наркологическая помощь[/url] .

Volvo в Україні https://novosti.stck.me/post/1800412/Kupit-spetstekhniku-SDLG-v-Ukraine/ екскаватори, фронтальні навантажувачі та дорожні машини. Надійність, ефективність і сучасні рішення для будівництва. Продаж, підбір і обслуговування техніки для бізнесу.

нарколог на дом [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-1.ru/]нарколог на дом[/url] .

вывод из запоя в стационаре [url=https://vyvod-iz-zapoya-na-domu-samara-8.ru/]vyvod-iz-zapoya-na-domu-samara-8.ru[/url] .

реабилитация алкоголиков [url=https://vyvod-iz-zapoya-na-domu-samara-9.ru/]vyvod-iz-zapoya-na-domu-samara-9.ru[/url] .

реабилитация наркоманов [url=https://vyvod-iz-zapoya-na-domu-voronezh-10.ru/]vyvod-iz-zapoya-na-domu-voronezh-10.ru[/url] .

реабилитационный центр от алкоголизма [url=https://vyvod-iz-zapoya-na-domu-voronezh-11.ru/]vyvod-iz-zapoya-na-domu-voronezh-11.ru[/url] .

капельница от похмелья [url=https://vyvod-iz-zapoya-na-domu-ekaterinburg-3.ru/]vyvod-iz-zapoya-na-domu-ekaterinburg-3.ru[/url] .

нарколог на дом [url=https://vyvod-iz-zapoya-na-domu-samara-8.ru/]нарколог на дом[/url] .

наркологический стационар [url=https://vyvod-iz-zapoya-na-domu-samara-9.ru/]vyvod-iz-zapoya-na-domu-samara-9.ru[/url] .

наркологический центр [url=https://vyvod-iz-zapoya-na-domu-voronezh-10.ru/]наркологический центр[/url] .

вывод из запоя на дому [url=https://vyvod-iz-zapoya-na-domu-voronezh-9.ru/]вывод из запоя на дому[/url] .

капельница от похмелья [url=https://vyvod-iz-zapoya-na-domu-voronezh-11.ru/]vyvod-iz-zapoya-na-domu-voronezh-11.ru[/url] .

Các trò chơi trên web đa dạng và phong phú.

Mình thấy web này đáng tin cậy và uy tín.

кодирование от алкоголизма [url=https://vyvod-iz-zapoya-na-domu-samara-10.ru/]кодирование от алкоголизма[/url] .

нарколог на дом [url=https://vyvod-iz-zapoya-na-domu-samara-11.ru/]нарколог на дом[/url] .

лечение наркомании [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-6.ru/]лечение наркомании[/url] .

вывод из запоя в стационаре [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-5.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod-5.ru[/url] .

реабилитационный центр от алкоголизма [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-4.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod-4.ru[/url] .

вывод из запоя в стационаре [url=https://vyvod-iz-zapoya-na-domu-voronezh-9.ru/]vyvod-iz-zapoya-na-domu-voronezh-9.ru[/url] .

лечение наркомании [url=https://vyvod-iz-zapoya-na-domu-samara-10.ru/]лечение наркомании[/url] .

нарколог на дом [url=https://vyvod-iz-zapoya-na-domu-samara-11.ru/]нарколог на дом[/url] .

реабилитация алкоголиков [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-6.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod-6.ru[/url] .

лечение наркомании [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-4.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod-4.ru[/url] .

Web mang lại trải nghiệm trực quan và mượt mà.

лечение алкоголизма [url=https://vyvod-iz-zapoya-na-domu-samara-10.ru/]лечение алкоголизма[/url] .

Mình đánh giá cao các tính năng tiện lợi trên web.

вывод из запоя в стационаре [url=https://vyvod-iz-zapoya-na-domu-samara-11.ru/]вывод из запоя в стационаре[/url] .

наркологический стационар [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-6.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod-6.ru[/url] .

капельница от запоя [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-4.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod-4.ru[/url] .

наркологический центр [url=https://vyvod-iz-zapoya-na-domu-samara-10.ru/]наркологический центр[/url] .

https://mine-drop1.com/

капельница от запоя [url=https://vyvod-iz-zapoya-na-domu-samara-11.ru/]капельница от запоя[/url] .

капельница от похмелья [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-7.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod-7.ru[/url] .

Нужны заклепки? заклепка вытяжная нержавеющая сталь прочный крепеж для соединения деталей. Алюминиевые, стальные и нержавеющие варианты. Надежность, долговечность и удобство монтажа для различных задач и конструкций.

наркологическая помощь [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg-1.ru/]наркологическая помощь[/url] .

реабилитация наркоманов [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg.ru/]vyvod-iz-zapoya-v-staczionare-sankt-peterburg.ru[/url] .

реабилитационный центр от алкоголизма [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg-2.ru/]vyvod-iz-zapoya-v-staczionare-sankt-peterburg-2.ru[/url] .

начальная школа онлайн [url=https://shkola-onlajn-43.ru/]начальная школа онлайн[/url] .

наркологическая помощь [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg-3.ru/]наркологическая помощь[/url] .

вывод из запоя на дому [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-4.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod-4.ru[/url] .

Mình cảm thấy an tâm khi tham gia trên web.

лечение наркомании [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-7.ru/]лечение наркомании[/url] .

Web cung cấp thông tin đầy đủ và chi tiết về các trò chơi.

реабилитационный центр от алкоголизма [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-6.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod-6.ru[/url] .

школы дистанционного обучения [url=https://shkola-onlajn-44.ru/]школы дистанционного обучения[/url] .

наркологический центр [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg-1.ru/]наркологический центр[/url] .

лечение наркомании [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg.ru/]vyvod-iz-zapoya-v-staczionare-sankt-peterburg.ru[/url] .

вывод из запоя на дому [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg-2.ru/]вывод из запоя на дому[/url] .

lbs [url=https://shkola-onlajn-43.ru/]lbs[/url] .

капельница от запоя [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-5.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod-5.ru[/url] .

наркологический стационар [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg-3.ru/]vyvod-iz-zapoya-v-staczionare-sankt-peterburg-3.ru[/url] .

наркологическая помощь [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-7.ru/]наркологическая помощь[/url] .

реабилитационный центр для наркозависимых [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg-2.ru/]vyvod-iz-zapoya-v-staczionare-sankt-peterburg-2.ru[/url] .

реабилитационный центр от алкоголизма [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg.ru/]vyvod-iz-zapoya-v-staczionare-sankt-peterburg.ru[/url] .

онлайн школы с зачислением [url=https://shkola-onlajn-44.ru/]shkola-onlajn-44.ru[/url] .

лечение алкоголизма [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg-1.ru/]лечение алкоголизма[/url] .

онлайн образование школа [url=https://shkola-onlajn-43.ru/]онлайн образование школа[/url] .

лечение алкоголизма [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-7.ru/]лечение алкоголизма[/url] .

вывод из запоя на дому [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg-3.ru/]вывод из запоя на дому[/url] .

наркологический стационар [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-5.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod-5.ru[/url] .

нарколог на дом [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg-2.ru/]нарколог на дом[/url] .

кодирование от алкоголизма [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg.ru/]vyvod-iz-zapoya-v-staczionare-sankt-peterburg.ru[/url] .

уроки онлайн [url=https://shkola-onlajn-44.ru/]уроки онлайн[/url] .

кодирование от алкоголизма [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg-3.ru/]кодирование от алкоголизма[/url] .

кодирование от алкоголизма [url=https://vyvod-iz-zapoya-v-staczionare-sankt-peterburg-1.ru/]кодирование от алкоголизма[/url] .

Семейное образование glolime [url=https://shkola-onlajn-43.ru/]Семейное образование glolime[/url] .

школа дистанционного образования [url=https://shkola-onlajn-45.ru/]школа дистанционного образования[/url] .

реабилитационный центр от алкоголизма [url=https://narkolog-na-dom-moskva-1.ru/]narkolog-na-dom-moskva-1.ru[/url] .

наркологический центр [url=https://narkolog-na-dom-moskva-2.ru/]наркологический центр[/url] .

наркологический стационар [url=https://vyvod-iz-zapoya-na-domu-nizhnij-novgorod-5.ru/]vyvod-iz-zapoya-na-domu-nizhnij-novgorod-5.ru[/url] .

Дистанционное образование [url=https://shkola-onlajn-45.ru/]Дистанционное образование [/url] .

наркологический стационар [url=https://narkolog-na-dom-moskva-1.ru/]narkolog-na-dom-moskva-1.ru[/url] .

кодирование от алкоголизма [url=https://narkolog-na-dom-moskva-2.ru/]кодирование от алкоголизма[/url] .

Промпты для нейросетей — готовые шаблоны – напиши промт для создания картинки

домашняя школа [url=https://shkola-onlajn-45.ru/]домашняя школа[/url] .

капельница от запоя [url=https://narkolog-na-dom-moskva-1.ru/]narkolog-na-dom-moskva-1.ru[/url] .

вывод из запоя на дому [url=https://narkolog-na-dom-moskva-2.ru/]вывод из запоя на дому[/url] .

Web mang đến trải nghiệm trực quan và dễ hiểu.

лечение наркомании [url=https://narkolog-na-dom-moskva-3.ru/]лечение наркомании[/url] .

обучение детей онлайн [url=https://shkola-onlajn-45.ru/]обучение детей онлайн[/url] .

лечение наркомании [url=https://narkolog-na-dom-moskva-4.ru/]лечение наркомании[/url] .

стоимость поролона [url=https://porolon-dlya-divana-1.ru/]porolon-dlya-divana-1.ru[/url] .

где купить поролон для матраса [url=https://porolon-dlya-divana-2.ru/]где купить поролон для матраса[/url] .

Web cập nhật thông tin mới liên tục, rất hữu ích.

купить мебельный поролон [url=https://porolon-dlya-divana-3.ru/]porolon-dlya-divana-3.ru[/url] .

нарколог на дом [url=https://narkolog-na-dom-moskva-2.ru/]нарколог на дом[/url] .

капельница от запоя [url=https://narkolog-na-dom-moskva-1.ru/]narkolog-na-dom-moskva-1.ru[/url] .

среднее образование онлайн [url=https://shkola-onlajn-44.ru/]shkola-onlajn-44.ru[/url] .

реабилитационный центр для наркозависимых [url=https://narkolog-na-dom-moskva-3.ru/]narkolog-na-dom-moskva-3.ru[/url] .

реабилитация наркоманов [url=https://narkolog-na-dom-moskva-4.ru/]реабилитация наркоманов[/url] .

лист поролона [url=https://porolon-dlya-divana-1.ru/]лист поролона[/url] .

поролон купить [url=https://porolon-dlya-divana-2.ru/]porolon-dlya-divana-2.ru[/url] .

поролон стоимость [url=https://porolon-dlya-divana-3.ru/]porolon-dlya-divana-3.ru[/url] .

наркологическая клиника [url=https://narkolog-na-dom-moskva-3.ru/]наркологическая клиника[/url] .

стоимость онлайн школы [url=https://shkola-onlajn-41.ru/]shkola-onlajn-41.ru[/url] .

Stackshine en.stackshine.io a SaaS cost management platform: subscription control, usage transparency, renewal tracking, and employee offboarding. Optimize your budget and reduce unnecessary software costs.

вывод из запоя в стационаре [url=https://narkolog-na-dom-moskva-4.ru/]вывод из запоя в стационаре[/url] .

lbs что это [url=https://shkola-onlajn-42.ru/]shkola-onlajn-42.ru[/url] .

Написать текст нейросетью онлайн. Подробнее можно посмотреть здесь: https://vc.ru/aihub/2842537-kak-napisat-tekst-neurosetyu-onlayn

плотный поролон [url=https://porolon-dlya-divana-3.ru/]плотный поролон[/url] .

заказать поролон [url=https://porolon-dlya-divana-2.ru/]заказать поролон[/url] .

вывод из запоя в стационаре [url=https://narkolog-na-dom-moskva-3.ru/]вывод из запоя в стационаре[/url] .

купить ппу для дивана [url=https://porolon-dlya-divana-1.ru/]купить ппу для дивана[/url] .

вывод из запоя в стационаре [url=https://narkolog-na-dom-moskva-4.ru/]вывод из запоя в стационаре[/url] .

онлайн образование [url=https://shkola-onlajn-41.ru/]shkola-onlajn-41.ru[/url] .

паралон цена [url=https://porolon-dlya-divana-3.ru/]паралон цена[/url] .

поролон мебельный в розницу [url=https://porolon-dlya-divana-2.ru/]porolon-dlya-divana-2.ru[/url] .

онлайн школа 8 класс [url=https://shkola-onlajn-42.ru/]shkola-onlajn-42.ru[/url] .

Web hỗ trợ người dùng nhanh chóng và nhiệt tình.

купить поролон для кровати [url=https://porolon-dlya-divana-1.ru/]купить поролон для кровати[/url] .

Các trò chơi trên web đa dạng và phong phú.

lbs [url=https://shkola-onlajn-41.ru/]lbs[/url] .

Онлайн образование [url=https://shkola-onlajn-42.ru/]Онлайн образование [/url] .

заказ курсовых работ [url=https://kupit-kursovuyu-102.ru/]kupit-kursovuyu-102.ru[/url] .

помощь студентам курсовые [url=https://kupit-kursovuyu-101.ru/]kupit-kursovuyu-101.ru[/url] .

вывод из запоя на дому [url=https://vyvod-iz-zapoya-na-domu-samara-19.ru/]вывод из запоя на дому[/url] .

реабилитационный центр от алкоголизма [url=https://vyvod-iz-zapoya-na-domu-samara-16.ru/]vyvod-iz-zapoya-na-domu-samara-16.ru[/url] .

капельница от похмелья [url=https://vyvod-iz-zapoya-na-domu-samara-17.ru/]vyvod-iz-zapoya-na-domu-samara-17.ru[/url] .

реабилитация наркоманов [url=https://vyvod-iz-zapoya-na-domu-samara-18.ru/]vyvod-iz-zapoya-na-domu-samara-18.ru[/url] .

Web mang lại cảm giác thoải mái khi chơi game.

Лучшие бесплатные нейросети 2026. Рекомендую всем: создать видео по описанию нейросеть бесплатно

Các danh mục trên web được bố trí hợp lý.

заказать студенческую работу [url=https://kupit-kursovuyu-102.ru/]kupit-kursovuyu-102.ru[/url] .

стоимость дистанционного обучения [url=https://shkola-onlajn-41.ru/]shkola-onlajn-41.ru[/url] .

Web giúp trải nghiệm chơi game trở nên tiện lợi và dễ dàng.

Các danh mục trên web được bố trí hợp lý.

Появились вредители? уничтожение насекомых цена обработка помещений от вирусов, бактерий и насекомых. Современные методы, безопасные средства и опытные специалисты для надежной защиты.

курсовая заказать [url=https://kupit-kursovuyu-101.ru/]курсовая заказать[/url] .

лечение наркомании [url=https://vyvod-iz-zapoya-na-domu-samara-16.ru/]vyvod-iz-zapoya-na-domu-samara-16.ru[/url] .

Уничтожение вредителей https://dezinfekciya-mcd.ru/ уничтожение бактерий, вирусов и насекомых. Обработка квартир, домов и коммерческих помещений. Безопасные препараты, опытные специалисты и гарантия результата.

покупка курсовой [url=https://kupit-kursovuyu-103.ru/]покупка курсовой[/url] .

лечение алкоголизма [url=https://vyvod-iz-zapoya-na-domu-samara-19.ru/]лечение алкоголизма[/url] .

Mình đánh giá cao sự chuyên nghiệp của web.

lbs live [url=https://shkola-onlajn-42.ru/]lbs live[/url] .

вывод из запоя на дому [url=https://vyvod-iz-zapoya-na-domu-samara-18.ru/]вывод из запоя на дому[/url] .

заказать курсовую срочно [url=https://kupit-kursovuyu-104.ru/]заказать курсовую срочно[/url] .

сайт для заказа курсовых работ [url=https://kupit-kursovuyu-105.ru/]сайт для заказа курсовых работ[/url] .

реабилитация алкоголиков [url=https://vyvod-iz-zapoya-na-domu-samara-17.ru/]vyvod-iz-zapoya-na-domu-samara-17.ru[/url] .

курсовые работы заказать [url=https://kupit-kursovuyu-106.ru/]kupit-kursovuyu-106.ru[/url] .

заказать курсовой проект [url=https://kupit-kursovuyu-102.ru/]заказать курсовой проект[/url] .

Mình cảm thấy thoải mái khi truy cập và chơi game trên web.

курсовая работа купить москва [url=https://kupit-kursovuyu-107.ru/]kupit-kursovuyu-107.ru[/url] .

сайт заказать курсовую работу [url=https://kupit-kursovuyu-103.ru/]сайт заказать курсовую работу[/url] .

Free online games poki.com.az play without downloading or registering. A large collection of games across various genres: action, puzzles, racing, and strategy. Easily access from any device.

Эта обзорная заметка содержит ключевые моменты и факты по актуальным вопросам. Она поможет читателям быстро ориентироваться в теме и узнать о самых важных аспектах сегодня. Получите краткий курс по современной информации и оставайтесь в курсе событий!

Подробнее – https://vivod-iz-zapoya-2.ru/

написание курсовой на заказ цена [url=https://kupit-kursovuyu-101.ru/]kupit-kursovuyu-101.ru[/url] .

наркологическая клиника [url=https://vyvod-iz-zapoya-na-domu-samara-16.ru/]наркологическая клиника[/url] .

цена курсовой работы [url=https://kupit-kursovuyu-108.ru/]цена курсовой работы[/url] .

сколько стоит заказать курсовую работу [url=https://kupit-kursovuyu-106.ru/]kupit-kursovuyu-106.ru[/url] .

лечение наркомании [url=https://vyvod-iz-zapoya-na-domu-samara-19.ru/]лечение наркомании[/url] .

написать курсовую на заказ [url=https://kupit-kursovuyu-105.ru/]написать курсовую на заказ[/url] .

Arizona sports events oxu-az football, transfers, and live match results. Latest news, statistics, and reviews for fans and sports enthusiasts.

курсовой проект купить цена [url=https://kupit-kursovuyu-104.ru/]курсовой проект купить цена[/url] .

реабилитация наркоманов [url=https://vyvod-iz-zapoya-na-domu-samara-18.ru/]vyvod-iz-zapoya-na-domu-samara-18.ru[/url] .

Free online games https://1001-oyun.com.az/ the best browser games with no installation required. Huge selection of genres, easy search, and quick launch. Play anytime for free.

сайт заказать курсовую работу [url=https://kupit-kursovuyu-103.ru/]сайт заказать курсовую работу[/url] .

курсовая заказать недорого [url=https://kupit-kursovuyu-107.ru/]kupit-kursovuyu-107.ru[/url] .

реабилитация наркоманов [url=https://vyvod-iz-zapoya-na-domu-samara-17.ru/]vyvod-iz-zapoya-na-domu-samara-17.ru[/url] .

Roblox Download delta-roblox.com.az Download the game, learn about Roblox Studio features, and learn about security settings. Play, create your own worlds, and protect your account. A complete guide to installing, playing, and using the platform safely.

https://mine-drop1.com/

курсовые заказ [url=https://kupit-kursovuyu-108.ru/]курсовые заказ[/url] .

нарколог на дом [url=https://vyvod-iz-zapoya-na-domu-samara-16.ru/]нарколог на дом[/url] .

куплю курсовую работу [url=https://kupit-kursovuyu-105.ru/]куплю курсовую работу[/url] .